说确凿,凡是想搞懂东说念主工智能,数学这关绕不外去。而所稀有学用具里,线性代数算是最底层的那一个——无论你是作念图像识别、折腾话语模子,还是饱读捣推选系统,背后番来覆去王人离不开它。

线性代数这东西,说白了,即是一种看全国的角度:甭管多复杂的东西,王人不错拆成几个特征的组合,再在某种轨则下不雅察它奈何动、奈何变。它搭起了一座桥,把我们这个摸得着的物理全国,映射到计较机能算的数字全国里。

【从标量到张量:维度的渐渐膨胀】

先从最概况的提及。

标量,即是个单独的数,整数、实数、复数王人行。

把一堆标量按端正排成一列,就变成了向量——尽头于给数加了个“维度”,想找到内部某个数,得看它在第几个位置。

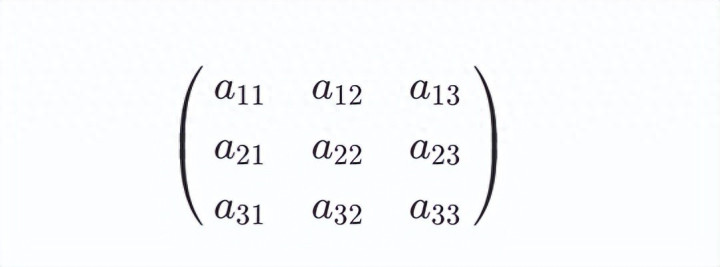

若是把向量的每个位置,再替换成一个向量,那就变成了矩阵。矩阵是二维的,定位一个元素需要两个坐标。

再往高维走,把矩阵里的每个元素再换成向量,那即是张量了。不错交融为维度更高的数据盒子。

举个具象的例子:一个三阶魔方,每个小方块里放一个数,通盘这个词魔方即是个三维张量;它的一面,即是一个矩阵。

计较机里也这样存的:标量是零维数组,向量是一维数组(比如一段语音),矩阵是二维数组(比如一张曲直相片),张量即是三维或更高维的数组(比如一张彩色图片,或者一段视频)。

【度量与联系:范数与内积】

有了这些基本结构,我们得有点度量它们的办法。

范数,即是用来推测一个向量“有多大”的。常见的L¹是十足值加起来,L²即是我们闇练的曲直,L∞则是看内部最大的阿谁数。范数只管一个向量我方的事儿。

而内积,看的是两个向量之间的联系——对应位置相乘再乞降。

内积能告诉你这两个向量“有多像”。如果内积是零,在二维里即是相互垂直;放到高维空间里,叫正交。正交意味着它们相互零丁,互不牵涉。

这种零丁性在骨子中挺灵验,比如你在作念特征分析的时间,正交的特征时常意味着信息不访佛。

【空间与参考系:线性空间与正交基】

如果再往前走一步:把通盘维数疏导的向量放在一齐,界说好加法和数乘,就酿成了一个线性空间。

若是再给它加上内积运算,就成了内积空间。

在线性空间里,每个向量王人不错算作空间里的一个点,反过来也相似——点和向量是逐个双应的。

但问题来了:光有空间还不够,你总得有个坐标系,武艺说了了点在哪儿。

这时间就需要正交基了——一组两两正交的向量,dafa大发手机版app如果每个长度王人是1,就叫轨范正交基。

它就像地球上的经纬度,定下来之后,每个点就有了笃定的位置。

专诚旨真理的是,并吞个空间不错有不同的正交基。比如二维平面,你用直角坐标也行,用极坐标也行——看问题的角度不同结果。

【变化与不雅察:线性变换与矩阵】

说到这儿,就得聊聊变化了。

线性空间最大的魔力之一,即是它能描述“变”。

一个点从这儿挪到那里,对应的向量就变了——这种变化叫线性变换,而描述它的用具,即是矩阵。

这里有个挺专诚旨真理的视角:

并吞个变换,你不错交融成对象动了,也不错交融成坐标系换了。

比如矩阵乘向量Ax = y,既不错看作向量x在矩阵A作用下变成了y,也不错看作并吞个对象,在不同坐标系(A和单元矩阵)下的不同抒发。

矩阵,既是变化的操盘手,亦然参考系自己。

【变化的中枢:特征值与特征向量】

那奈何交融矩阵这个“操盘手”到底在干什么呢?

特征值和特征向量即是干这个的。

对大大王人向量来说,矩阵作用上去,宗旨和大小王人会变。

但有那么一类非常的向量,宗旨不变,只伸缩——这类就叫特征向量,伸缩的比例即是特征值。

特征值代表变化的速率,特征向量代表变化的宗旨。

打个譬如:如果矩阵是个驰驱的东说念主,特征值即是速率,特征向量即是宗旨。

但这个东说念主不是鄙俚东说念主,他有三头六臂——每个头朝着不同宗旨、以不同速率跑,合起来才是他实在的畅通。

特征值剖析能把这个经由间隔看,但它只适用于方阵。

关于更一般的矩阵,就得用奇异值剖析了,算是特征值剖析的“升级版”。

【写在终末】

回偏激来看,线性代数实在作念的事,是给东说念主工智能提供了一套概述话语,用来描述全国的结构和变化。

它不仅仅一个用具包,更像是一种想维形态——把隐隐的推行,拆成可计较、可操作的数学对象。

个东说念主合计,学线性代数最怕的即是一启动就扎进公式堆里,绕晕了。

反倒是先把这些“为什么”想了了,知说念每个见地到底在描述什么,再去碰那些计较细节,会顺许多。

毕竟大发官方网站,公式仅仅用具,背后阿谁“看全国的形态”,才真偶合钱。

金佰利国际娱乐官网入口